Téma

- #Helyi telepítés

- #Ollama

- #Személyes adatvédelem

- #LLM

- #Nyelvi modell

Létrehozva: 2024-11-09

Létrehozva: 2024-11-09 17:46

Az Ollama egy könnyű súlyú keretrendszer a helyi nyelvi modellek futtatásához. Ez a keretrendszer a modell súlyait, beállításait és adatkészleteit egyetlen integrált csomagba köti össze, hogy optimalizálható legyen a különféle mesterséges intelligencia alkalmazásokhoz.

Az Ollama weboldaláról letöltheti a Mac, Linux és Windows rendszerekhez készült telepítőfájlokat.

A telepítés befejezése után futtassa az Ollama alkalmazást.

A terminálban a következő parancsokat adhatja meg:

Az Ollama részletesebb interakciókhoz API-t is kínál. További információkért látogasson el ide:

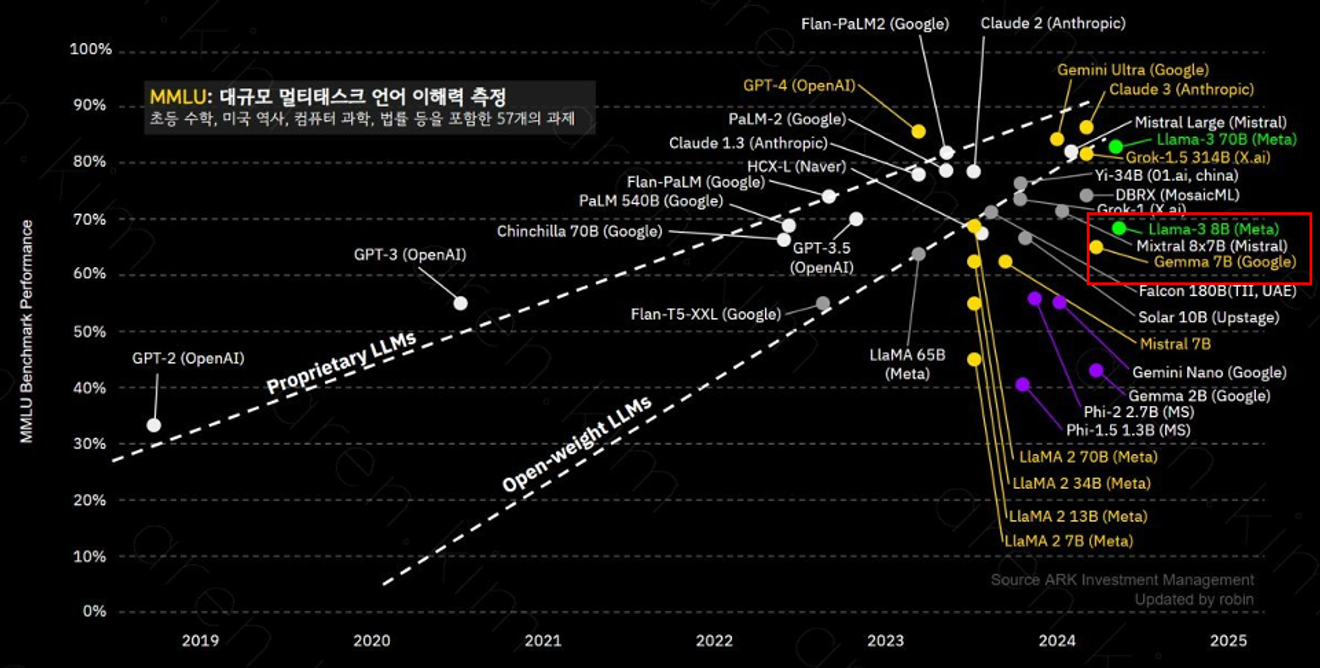

Az Ollama számos modellt támogat, köztük a llama-3 8B modellt, amely 8 milliárd paraméterrel rendelkezik, és kiváló a komplex kontextus megértésében és a problémamegoldásban. Az egyes modellek teljesítménye a paraméterek számától és a képzési adatoktól függ, ezért fontos a felhasználási célnak megfelelő modell kiválasztása.

A llama-3 8B modell a GPT-3.5-höz hasonló teljesítményt nyújt.

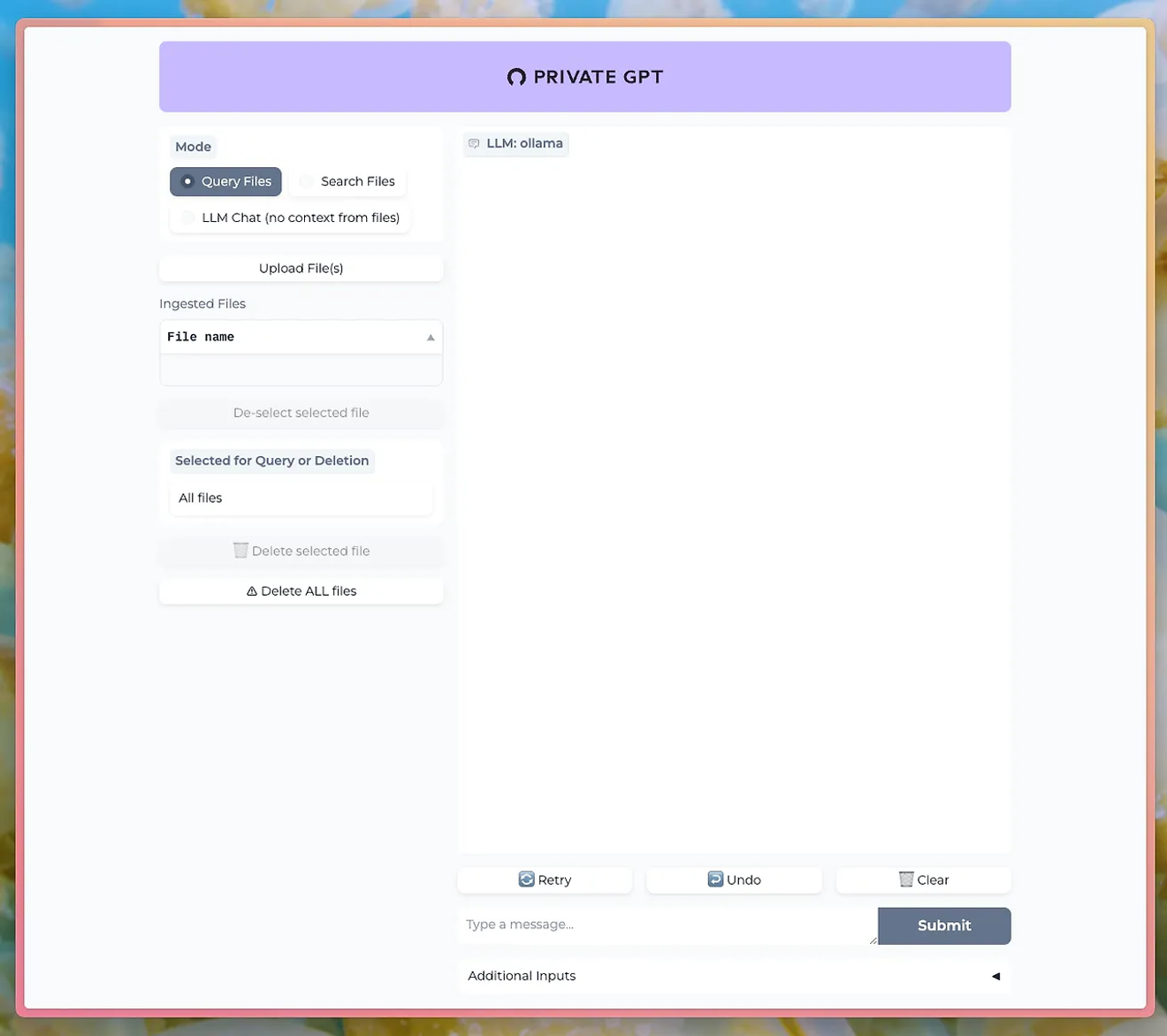

A PrivateGPT-hez hasonló eszközök segítségével az Ollama LLM-jén keresztül chat felületen is kommunikálhat.

http://PrivateGPT GitHub

A dokumentum feltöltési funkció használatához telepíteni kell az Ollama nomic-embed-text modelljét.

Az Ollama használatával megőrizheti az adatvédelmet és az adatbiztonságot, miközben élvezheti a hatékony természetes nyelvi feldolgozás előnyeit. Ez különösen fontos előny a bizalmas adatokkal foglalkozó vállalkozások vagy kutatások számára.

Ismerje meg az Ollama használatát, és futtassa a saját LLM-jét helyben. Ne hagyja ki a lehetőséget, hogy közvetlenül vezérelje a nagy teljesítményű természetes nyelvi feldolgozást, és azonnal lássa az eredményeket!

Hozzászólások0